Wykorzystanie deepfake do scenariusza „fraud inwestycyjny”

Stosowana przez przestępców wyrafinowana socjotechnika w tym scenariuszu powoduje, że spora liczba osób chcących szybko się wzbogacić, pada ofiarą gry psychologicznej przestępców, w konsekwencji czego traci często wszystkie swoje oszczędności, a niejednokrotnie pozostaje także z długami. Kiedy wydawało się, że przestępcy osiągnęli już szczyt swoich możliwości, okazało się, że nadal potrafią wzbogacać wykorzystywane przez siebie metody. Ale prześledźmy scenariusz po kolei…

Przypomnienie schematu działania:

Zaczyna się najczęściej od reklamy w mediach społecznościowych, w której to możemy przeczytać o rewolucyjnej, ale ukrywanej do tej pory metodzie na szybki zarobek. W tego typu materiałach, bardzo często wykorzystywany jest wizerunek znanych osób oraz instytucji. Atakujący przygotowują nawet artykuły pokazujące np. życie rzekomej osoby, która zainwestowała i nie musi już pracować, będąc niebagatelnie bogatą.

Przykładowe fałszywe reklamy

Brzmi pięknie, prawda? Jeżeli tak samo uzna osoba, której wyświetliła się taka reklama, to kliknie w nią i zostanie przekierowana na stronę (lub do formularza Facebook) na której jedyne co będzie miała podać, to dane kontaktowe do siebie (imię, adres e-mail, numer telefonu) i to by było na tyle… teraz należy czekać. Jednak czas oczekiwania nie jest długi, bo szybko, telefonicznie skontaktują się przestępcy, którzy przedstawią się np. jako „doradcy inwestycyjni”. Gra psychologiczna nabiera tępa, przestępcy przekonują ofiarę do przelewania kolejnych środków. I tak, zdarza się, że nieświadoma niczego osoba, przez kilka tygodni żyje w przekonaniu, że jej życie niedługo się zmieni, snuje plany o nowym domu, samochodzie i wakacjach, a później… marzenia prysną, a długi pozostaną.

Bardziej szczegółowo ten scenariusz opisaliśmy w serii schematów oszustw, dostępnych pod adresem: https://cebrf.knf.gov.pl/encyklopedia-cyberbezpieczenstwa/schematy-oszustw/falszywe-inwestycje

Gdzie w tym wszystkim sztuczna inteligencja?

Otóż na samym początku… A dokładniej: cyberprzestępcy wykorzystując metodę deepfake tworzą nagrania, w których znane publicznie osoby (aktorzy, politycy, influencerzy) rzekomo twierdzą o zakończeniu zmowy milczenia i chęci ujawnienia rewolucyjnej metody zarabiania. Jeżeli w statycznej reklamie nie daliśmy się nabrać na możliwość inwestowania w Baltic Pipe, albo Tauron, to czy oprzemy się nagraniu, w którym twarz Roberta Lewandowskiego (lub kogoś innego) mówiąca barwą jego głosu informuje nas, że to my mamy szczęście, bo to my możemy odmienić swoje życie? Nad tą pokusą trudniej zapanować, ten sposób oszustwa trudniej rozpoznać, przestępcą łatwiej oszukiwać!

Z przykładowym nagraniami deepfake, wykorzystywanym przez cyberprzestępców, można zapoznać się w naszej bazie: https://cebrf.knf.gov.pl/deepfake

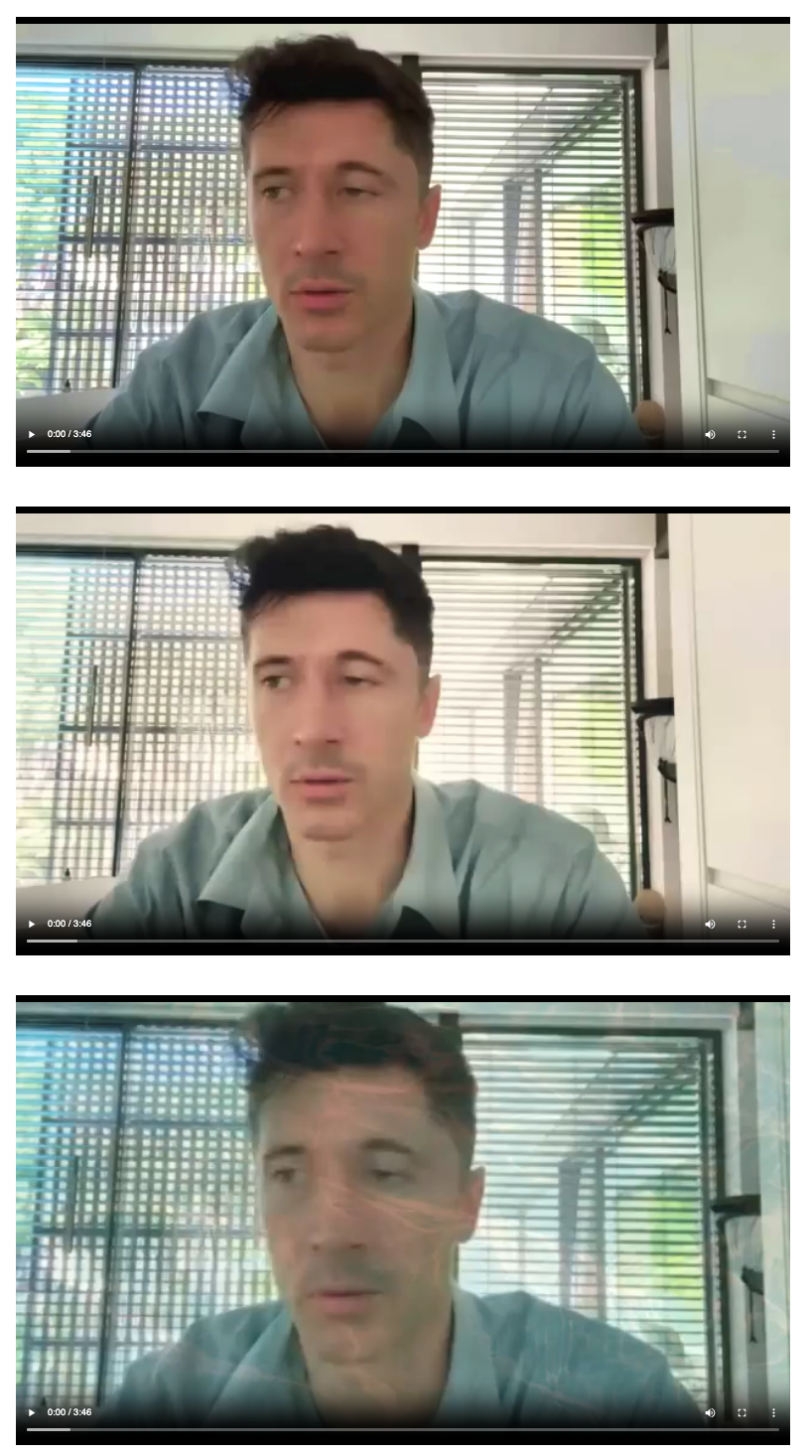

Warto zwrócić uwagę, na jakość przygotowanych nagrać video. Analizując ich wiele, wyraźnie widzimy, że atakujący zwiększają swoje umiejętności tworzenia tego typu nagrać, a i może korzystają z coraz to lepszych narzędzia AI.

Czy takie filmiki są wykrywane?

Oczywiście! Jednak o tym, że są podejmowane działania mające na celu wykrycie takiego fałszywego nagrania i zgłoszenie go do platformy, na której zostało opublikowane, doskonale wiedzą przestępcy. Naturalnym jest zatem, że zaczynają modyfikować swoje nagrania, tak by automatyczne algorytmy nie rozpoznawały użycia sztucznej inteligencji, do ich stworzenia. W tym celu dodają tzw. „szumy” do swoich nagrań. Ogólnie mówiąc, jest to pewnego rodzaju warstwa nałożona na video (widoczna gołym okiem jako „kropeczki” lub „mgła”), dzięki czemu automaty mają oznaczyć nagranie jako nie przygotowane poprzez wykorzystanie metody deepfake. Tym samym, niezgłoszone do zablokowania.

Przykładowe dodanie "szumów" do nagrań deepfake